Cette réglementation s’inscrit dans la suite du RGPD. Elle détermine, tous secteurs confondus, la criticité des cas d’usage, selon 4 niveaux de risques : interdits à l’IA, à haut et bas risques et sans enjeu.

Les cas d’usage considérés comme à « haut risque » vont notamment devoir faire l’objet d’une certification de conformité. Cette certification (qui va s’articuler et être définie par État membre et filière) donnera un gage de confiance (trustworthy AI)

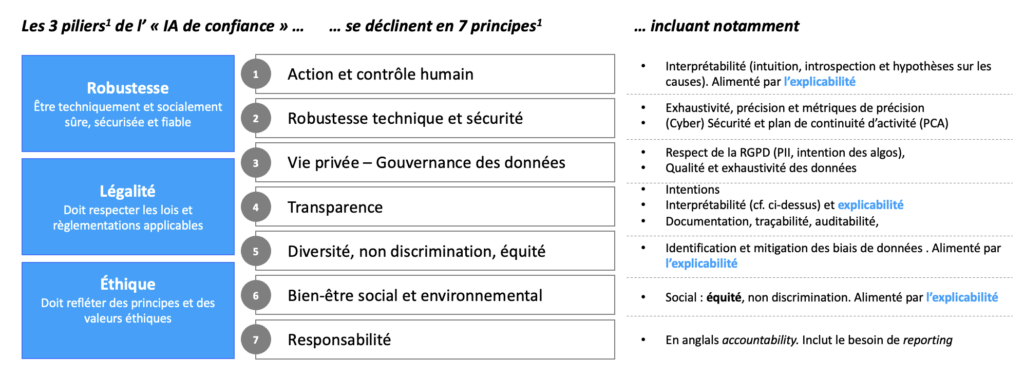

La notion d’IA de confiance est un concept qui a fait l’objet de nombreux travaux dans le monde entier. Un consensus (qui sera tranché par l’AI act) semble s’orienter vers le cadre suivant :

L’explicabilité est un enjeu transverse. AI-vidence s’est donné comme mission d’y contribuer de façon déterminante.

AI-vidence suit attentivement le processus législatif européen en cours. Après la proposition de texte initial de la Commission, le Conseil puis le Parlement ont amendé le texte. Le réglement est actuellement à l’étape du trilogue, la Commission, le Conseil et le Parlement travaillant de concert en vue d’aboutir à une version commune du texte. Ensuite (fin 2023), la mise en application du texte devra être établie pour chaque état membre : quelles autorités sont en charge de spécifier le conformité de tel ou tel cas d’usage ? quelle organisme devra assurer le marquage CE? vérifier la conformité ?

En France, grâce aux efforts de la Direction Générale des Entreprises et d’organisations représentant les acteurs du secteur IA (France Digitale, le Hub France IA, datacraft …), AI-vidence suit attentivement l’évolution du texte afin que notre produit réponde au mieux aux exigences de conformité.

Pour approfondir : s’abonner à l’infolettre « the artificial intelligence act«